Слідкувати за науково-технічним розвитком – заняття захопливе. Сучасні рішення, у тому числі й комунікаційні, часом вражають уяву. Здавалося б: наслідки прогресу мають бути позитивними для людства, проте на практиці буває по-різному. Усе залежить від того, у чиїх руках опиняється новий винахід.

Про діпфейки це також можна сказати: технологія могла би використовуватися з користю, але насправді вона вже принесла немало прикростей.

***

ЩО ТАКЕ ДІПФЕЙК

Назва діпфейк (англійською DeepFake) походить від поєднання інших англійських слів – Deep Learning та Fakes. У буквальному перекладі це означає «глибинне навчання» та «підробка, дезінформація».

Отже, діпфейк – це методика синтезу зображень людей, що реалізується за допомогою штучного інтелекту.

Також діпфейками називають і власне створені фальшиві відео, зображення, аудіо або інший цифровий контент з «реальними» людьми «у головних ролях».

Такі матеріали можуть бути надзвичайно реалістичними. Підробки, створені за допомогою сучасних технологічних засобів, іноді майже неможливо візуально відрізнити від реального відео, фото чи аудіо.

Маніпуляції з медіа відомі здавна, власне, від часів появи самих медіа. Редагування фото – це теж своєрідна маніпуляція. Проте зараз цей процес просунувся далеко вперед. У наші дні підробку фото виявити найлегше, а от із відео та аудіо все складніше. За останнє десятиріччя у цьому питанні маємо значний технологічний стрибок.

Програми створення діпфейкового відео дозволяють повністю відтворити зовнішність людини. Для цього штучний інтелект аналізує велику кількість фото певної людини, збирає дані та відтворює зображення. Створена «цифрова маска» накладається на відео, при цьому також відбувається синхронізація голосу, жестів, рухів.

Сем Ґреґорі, експерт у сфері нових форм цифрової дезінформації, каже, що назва «діпфейк» не найвдаліша для позначення маніпуляцій, пов’язаних із підміною облич. Він говорить про термін «синтетичні медіа», що охоплює підміну облич, дубляж із синхронізацією руху губ, можливість зміни положення тіла чи обличчя. Технологія дозволяє навіть синтезувати події та створювати обличчя, яких ніколи не існувало у природі.

***

ДЛЯ ЧОГО СТВОРЮЮТЬСЯ ДІПФЕЙКИ

Здебільшого про діпфейки прийнято думати як про інструмент дезінформації, чорного піару та введення в оману для якихось недобрих справ. Наприклад, їх використовують шахраї та злочинці, шантажуючи фальшивими матеріалами своїх жертв (і цими жертвами можуть бути звичайні люди, необов’язково відомі).

Проте технологія може використовуватися і з цілком «мирною» метою – наприклад, у сфері кіно. Вона дозволяє «замінити» актора у небезпечних трюках або «оживити» зірок минулого. Цікавою можливістю є перспектива діпфейкового дубляжу. Відеоряд не потрібно дублювати – обличчя акторів можна буде редагувати так, ніби вони говорять різними мовами. Наразі це лише творчі плани, але ж усе, зрештою, починається з творчих планів.

Одним із найвідоміших діпфейків є відеоролик 2018 року з виступом Барака Обами.

https://www.youtube.com/watch?v=cQ54GDm1eL0&ab_channel=BuzzFeedVideo

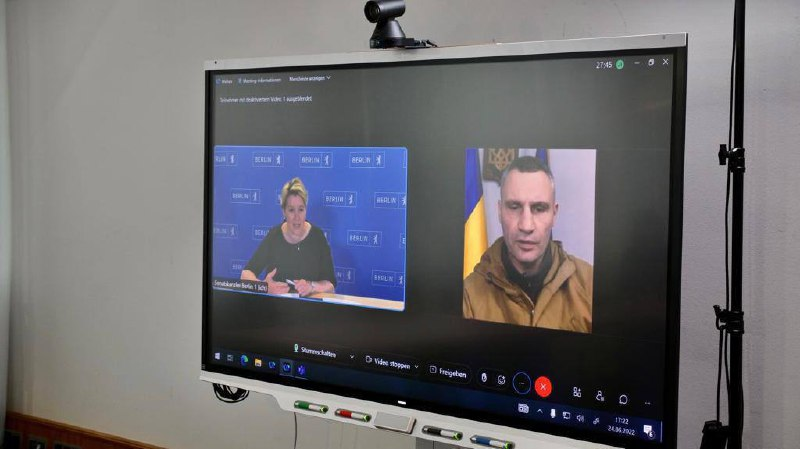

Багато українців добре пам’ятають, як у червні минулого 2022-го року зловмисник під виглядом мера Києва Віталія Кличка розмовляв у zoom із мерами Мадрида та Берліна, про що сам Кличко повідомив на своїй сторінці в Telegram. За словами представників берлінського Сенату, спілкування тривало близько півгодини, співрозмовник виглядав як Кличко, і спочатку бесіда не викликала жодних підозр. Проте під кінець розмови бургомістр Берліна запідозрила, що щось не так. Мер Мадрида, з яким шахрай зв’язувався пізніше в той же день, практично зразу засумнівався у «справжності» співрозмовника, тому перервав зв’язок.

Фото: Віталій Кличко/Telegram

Фото: Віталій Кличко/Telegram

І, напевно, всі пам’ятають недолугий діпфейк, який запускали росіяни: звернення «Володимира Зеленського» на початку повномасштабного вторгнення із заявою про капітуляцію України. Проте цей діпфейк був зроблений неякісно, тож він зовсім не мав очікуваного росіянами ефекту.

https://www.youtube.com/watch?v=X17yrEV5sl4&ab_channel=TheTelegraph

***

ЯК РОЗПІЗНАТИ ДІПФЕЙК

Розпізнати медіапідробку може бути дійсно складно, проте можливо.

По-перше, важливо критично мислити. Завжди треба перевіряти інформацію, послуговуватися надійними джерелами, не поширювати сумнівні дані.

По-друге, деякі ознаки діпфейкових матеріалів можна помітити візуально. Якщо розглядати відео покадрово, можна побачити таке:

обличчя не завжди пропорційно «накладається» на тіло, краї «маски» не всюди рівні;

біля очей та брів можуть пролягати дивні тіні;

неприродний відтінок кольору шкіри;

окуляри чи інші великі аксесуари можуть мати відблиски, котрі не гармоніюють із загальною картинкою;

на діпфейкових відео волосся часто виглядає неприродно: може бути «розмитим» чи мати неправильну лінію росту;

невідповідна міміка та рухи (зокрема рух очей!).

По-третє, існують програми, які допомагають боротися з діпфейками. Приміром, у 2020 році компанія Microsoft оголосила про вихід у світ технології Microsoft Video Authenticator, яка аналізує зображення та відео і визначає їх справжність. Цей напрям активно розвивається, оскільки розвиваються і діпфейки.

Уже згадуваний Сем Ґреґорі є програмним директором проєкту «Witness»,створеного для захисту прав людини за допомогою відео і сучасних технологій. Завданням, яке ставить перед собою ця та інші подібні ініціативи, є пошук ефективних методів прогнозування та запобігання негативним наслідкам уже зараз, на початку розвитку цих технологій.

Серед ключових кроків, здатних убезпечити людство від потенційної шкоди діпфейків, проєкт «Witness», зокрема, визначає:

визнання та усунення вже нанесеної шкоди;

визначення глобальних загроз;

просування міждисциплінарних підходів, які вже існують сьогодні: перевірка фактів, протистояння дезінформації, робота з відкритими джерелами тощо;

створення можливостей для ключових гравців – пошукових гігантів, ЗМІ та інших – для кращого розуміння загрози та більш тісної співпраці між ними задля її подолання;

визначення засобів координації між громадянським суспільством та ЗМІ;

проведення подальших досліджень розвитку технології;

створення ґрунту для відповідальності тих, хто створює комерційний продукт, який сприяє появі та поширенню діпфейк-контенту, розробка норм і правил поведінки на ринку;

створення умов для рівного доступу до технологій виявлення подібного контенту;

поширення та популяризація етичних стандартів.

***

В Україні йде війна. Інформаційний фронт – теж фронт. Для боротьби ми використовуємо різні засоби і ресурси, але й ворог також. Про це слід пам’ятати, як і про те, що не варто недооцінювати суперника. Тож важливо цікавитися розвитком інформаційно-комунікаційних технологій і вивчати, де різні винаходи можуть бути корисними, а де – зашкодити.

Ілюстрація: steffen wienberg, відкритий ресурс Unsplash

Авторка: Юлія Панченко